Fra AI-risici til strategier: ISO 42001 viser vejen frem

Hvis man spørger den nuværende, gratis udgave af ChatGPT, vil den højst sandsynligt svare, at ISO 42001 er en standard til kvalitetssikring ift. canabisproduktion 😅 men det er nu ikke helt korrekt …

Den nye EU-forordning om AI er trådt i kraft tidligere i år. Og det betyder at stortset alle virksomheder i EU på et eller andet tidspunkt fra nu og frem mod efteråret 2026 vil skulle tage stilling til, hvordan de bruger AI i deres processer, ydelser og produkter.

Den nye ISO 42001:2023 er derfor kommet som en hjælp til virksomheder ift. at navigere i AI-landskabet.

Når man dykker ned i ISO 42001, er det især kapitel 5.2 om AI politikken og 6 planlægning, der er interessante. ISO 42001 er som de fleste andre ISO standarder bygget op ovr highlevel structure, og den kan derfor fint indgå som addon til jeres eksisterende ledelsessystem.

I kapitel 6 bliver vi bedt om at tage stilling til AI risici ift.:

✅ Assessment

✅ Treatment og

✅ System impact

Hvor hver af disse områder har en paragraf for sig selv. Hvis man som virksomhed ikke er vant til at lave dybdegående risikoanalyser og mitigering, så giver denne standard en detaljeret overblik over, de enkelte trin i et sådant arbejde. En diciplin, der under alle omstændigheder, er værdifuld for en hver organisation.

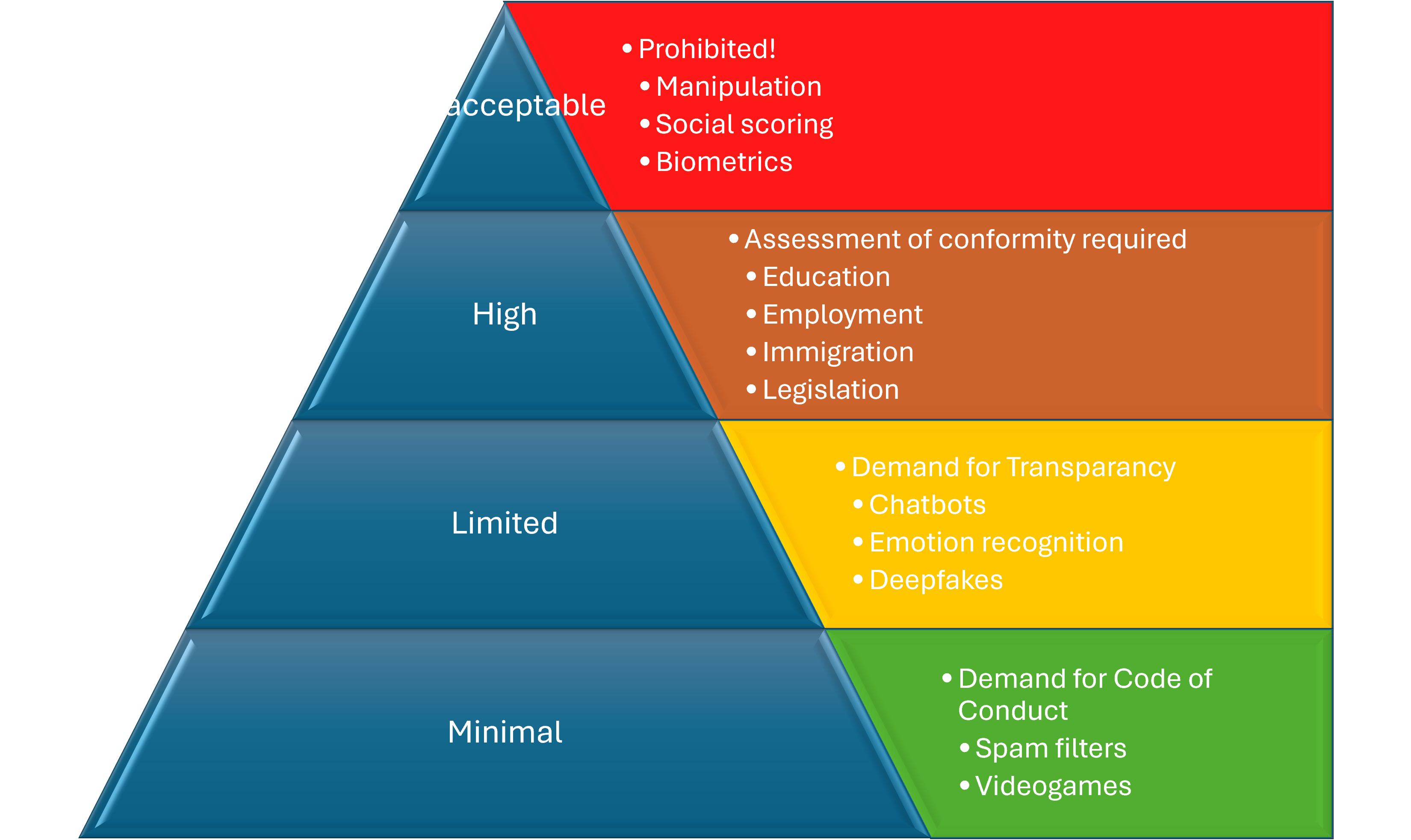

Risikokategorier

EU arbejder med 4 risikokategorier i forhold til brug af AI i processer, ydelser og produkter.

Ifølge implementeringsplanen skal al brug af AI indenfor EU, som hører under risikokategori “Unacceptable” være ophørt med udgangen af februar 2025. Herefter er det kun brug af AI indenfor de øvrige 3 risikokategorier, der må anvendes indenfor EU’s grænser.

Vil du høre mere om mulighederne i jeres eksisterende Microsoft M365 licenser?

Kontakt os HER.